- Bivalyerős lett a Poco F6 és F6 Pro

- Netfone

- Egyre közelebb a Poco F6 startja

- Bemutatta első fejhallgatóját a Sonos

- Bugfix van, magyarázat nincs az iOS-ben újra feltűnő, korábban törölt fotókra

- Nokia 3210 - felélni az örökséget

- Magisk

- Samsung Galaxy A54 - türelemjáték

- Vodafone mobilszolgáltatások

- Realme GT Master Edition - mestermunka

Hirdetés

-

Hunt: Showdown - Jön az engine csere, befutnak az újgenerációs verziók

gp A PlayStation 4 és Xbox One változatok automatikusan frissülnek az új kiadásra.

-

1000 Hz-es játékos monitor TCL CSOT recept szerint

ph A vállalat prototípusa kihagyott egy-két lépcsőfokot, ugyanis az elképesztő képfrissítési tempóhoz 4K-t párosít.

-

Touroll J1 - amikor az átlagos is elég

ma A megszokott konstrukciót, vagyis pedálszenzort és hátsó agymotort kínál a Touroll, nincs benne semmi rendkívüli, de kedvező az árfekvése.

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

VoltanIgor

tag

[link] Forspoken review - egyelőre csak ps5-re. Az a legkevésbé sem lep meg, hogy hatalmas pofára esés az egész cucc, de az azért mókás, hogy milyen mocsok ocsmányul is néz ki a videó 90%-ban. Esküszöm, a Witcher 3 ennél sokkal, SOKKAL szebb volt. Nem, nem most, a felpimpelt ray tracinggel, anno, amikor megjelent.

Nagyon kíváncsi leszek holnap a PC-s videókra, kritikákra

-

válasz

#82860288

#40050

üzenetére

#82860288

#40050

üzenetére

Hát ez is egy bughalmaz lett, megjelenésre lebutított grafikával, inkább nevetséges már az egész.

Néztem a játékmenetet és szemcsés morzsás gyors mozgásnál a kép mi ez már? 480p? fsr vagy felskálázás? vagy mi? Ninsc egy szabályos éles alakzat vagy él mozgás közben, mint egy 3D anyag. [link][ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

#82860288

törölt tag

Nem tudtam eldönteni, hogy a textúrák kis méretűek vagy változik a felbontás játék közben vagy csak egyszerűen rossz az optimalizáció, már ha van. Most még belenéztem kicsit, nagyon sok helyen homályos a kép, rosszak a textúrák.

Viszont meg is lepődtem közben, mert azt gondoltam ez UE5 játék, és nem, valami Luminous Enginet használ. -

[Nvidia to Win Big From ChatGPT Hype, Wall Street Predicts]

ChatGPT sok pénz kezd el hozni Nvidiának, úgy látszik a Geforce lassan mellékszál lesz.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

#82860288

törölt tag

Azért ez a fa sem fog az égig nőlni, bár tény, hogy nagyon sok lehetőség van benne, reméljük azért jó célokra használják majd, de ez még sok év lesz, mire kiforr.

De nem hiszem, hogy Nvidia feladná a VGA piaci vezető szerepét, azt nem engedhetik meg maguknak.

Bár én azt sem bánnám, ha egy kicsit optimalizálnák ezeke ta kártyákat vagy kevesebb verziót gyártanának belőle. -

S_x96x_S

őstag

> ChatGPT sok pénz kezd el hozni Nvidiának,

"""

❗Reminders:

- OpenAI's GPT-4 is coming.

- AnthropicAI's 'Claude' is coming.

- DeepMind's 'Sparrow' is coming.

- Text-to-Video is coming.

- StabilityAI is cooking.

- Google is Code Red.

- Blake Lemoine was right.

"""

( https://twitter.com/SmokeAwayyy/status/1617082270501965826 )Nem árt felkészülni ..

https://terminator.fandom.com/wiki/SkynetMottó: "A verseny jó!"

-

#82860288

törölt tag

Hát, VRAM-ból is megeszik 17 gigát, RAM-ból is 20-at és még állítólag DirectStorage is van, és mégis úgy néz ki ahogy.

Nekem ez borzasztóan színtelen és nem szép. Nem tudom a butított 1440p mennyire más, mint az eredeti 4K, de azért ennél sokkal többet vártam egy next gen játéktól.

PS5-ön más játékokon a next gen frissítések jobban néznek ki. -

Abu85

HÁZIGAZDA

válasz

#82860288

#40058

üzenetére

#82860288

#40058

üzenetére

A DirectStorage kapcsán írtuk, hogy az memóriazabáló. Annak nem az a lényege, hogy spóroljon a VRAM-mal. Éppen ellenkezőleg, hogy a több VRAM-ból sebességet kovácsoljon, miközben megszűnnek a töltőképernyők.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

#82860288

törölt tag

Nem az a baj, hogy mennyi erőforrást használ, hanem az, hogy ennek ellenére csúnya a játék.

Persze nyilván ez stream volt, az is butítva bitsebességben is, stb.

De se a 4K tévén, se a FHD monitoron és se a 10" tableten nem néz ki jól.

És most nem az elmosódott akciójelenetekről van szó, hanem arról, amikor csak bóklászik a világban.

Próbálgat sok mindent, RTX ki-be, DLSS ki be, stb, de nem igazán vannak nagy különbségek, bár ez lehet a YT tömörítés miatt is van.

De ahhoz képest amennyire hypeolták ezt a játékot és amilyen minőségű felvételeket megosztottak előzőleg, ez bizony durván nem az a minőség.

Pedig elvileg ennek el kellene adnia a játékot is, meg az Nvidia kártyákat is meg még sok mást is attól függően milyen reményeket fűztek hozzá. -

Abu85

HÁZIGAZDA

válasz

#82860288

#40061

üzenetére

#82860288

#40061

üzenetére

A DLSS különbség nehezen látható a streameken. Ez máshol is így van.

Az RT-t rossz helyen nézi. A shadow különbségéhez árnyékot kell néznie, az AO-hoz pedig környezeti árnyékolást. Maga az RTAO nem egyedüli AO megoldás a játékban. Egy kombináció a CACAO és az RTAO között. Az a célja, hogy a CACAO minőségét hozza, de anélkül, hogy fake árnyékolást generálna. Tehát az RTAO-t a Forspoken nem igazán AO-ra használja, hanem a CACAO segítésére.

[link] - bővebben az effektek prezentálva a különbségekkel.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

prime77

aktív tag

Tudom nem ide vág, de sokszor volt már arról szó, hogy a mai játékok elég gyatrán néznek ki grafikailag - legalább is szerintem!

Szinte minden játék olyan mint az 5 évvel ezelőttiek.

Beteszek ide egy videót az RDR2-ről, ami egy "mod" tulajdonképpen.

Na, erre mondom azt, hogy ilyen videókártya és számítógép árak mellett, ennél a grafikánál egy játék se nézzen ki rosszabbul.

Én ilyet még nem láttam, és kicsit leesett az állam tőle.

Nézzétek meg!

Másfél percnél az az erdő, és a ló patáján, ahogyan a sár "táncol" - elképesztő!

És ez egy RTX 3080Ti - maximális beállítások mellett - 4K felbontással!

Az éjjeli városi jelenet is bitang.

https://www.youtube.com/watch?v=HnVWyCp5Jd4[ Szerkesztve ]

-

[Nvidia to build the U.K.'s fastest supercomputer for AI drug-hunters at GSK, AstraZeneca and more]

Plusz kibővítik a ChatGPT hardveres betanítási modelljét, mert annyira népszerű lett, hogy akadozik a drága. Úgy néz ki hogy ezek a dolgok ellensúlyozzák majd a geforce vonal gyengélkedését sajnos, egyre reménytelenebbnek látom a komoly árcsökkentést.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

-

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

S_x96x_S

őstag

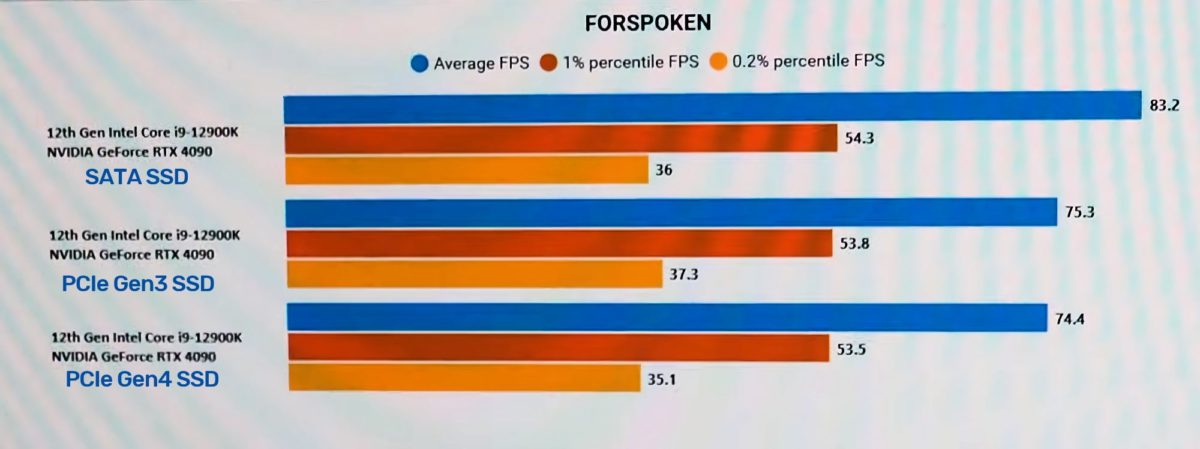

max 10% a directstorage hatása az fps -re .. de ha lesz Gen5-ös diszk, akkor további javulás várható.

"DirectStorage in Forspoken has up to 10% average FPS impact on RTX 4090"

https://videocardz.com/newz/directstorage-in-forspoken-has-up-to-10-average-fps-impact-on-rtx-4090

Mottó: "A verseny jó!"

-

S_x96x_S

őstag

igennn ..

de hátha addigra csak megjön rá a javítás![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

PuMbA

titán

válasz

S_x96x_S

#40070

üzenetére

S_x96x_S

#40070

üzenetére

Semmi nem lesz Gen5-tel, mikor a Gen3 és Gen4 között semmi különbség nincs

Egy Gen3 SSD bőven elég lesz bármire évekig, mert annyira sok adatot képes az is mozgatni, ami egy jelenethez sosem lesz kevés, még 4K textúrákkal se. A Gen5 marad az ésszerűségen kívül.

Egy Gen3 SSD bőven elég lesz bármire évekig, mert annyira sok adatot képes az is mozgatni, ami egy jelenethez sosem lesz kevés, még 4K textúrákkal se. A Gen5 marad az ésszerűségen kívül.[ Szerkesztve ]

-

S_x96x_S

őstag

> Semmi nem lesz Gen5-tel, mikor a Gen3 és Gen4 között semmi különbség nincs

azért van különbség,

csak a 4090-es - extra nagy memóriája miatt ( Memory Size: 24 GB )

ITT nem az lesz a szűk keresztmetszet.a Gen5 M.2 -nél ráadásul a latency követelmények is szigorúbbak, mint a Gen3/Gen4 -nél.

és ennek van hatása is.

"Lastly, we have the latency figures which show up to 77% reduction in Read and 50% reduction in Write latencies. So all in all, we have some pretty big numbers coming in for next-gen PCIe 5 SSDs." ( via )

> Egy Gen3 SSD bőven elég lesz bármire évekigHa egy 4090 -es GPU van a gépedben, akkor igazad van ..

de nem mindenkire igaz ez ..Vagyis megint attól függ, hol a rendszer szük keresztmetszete.

Egy GPU RAM cache mindig gyorsabb mint egy diszk.Több Forspoken teszt kell mert a végén az derül ki,

hogy a 4090-es is felesleges a konfigból.![;]](//cdn.rios.hu/dl/s/v1.gif)

Mottó: "A verseny jó!"

-

S_x96x_S

őstag

> Semmi nem lesz Gen5-tel, mikor a Gen3 és Gen4 között semmi különbség nincs

egy mákszemnyi különbség is már több mint a "semmi" ..

és itt többről van szó.

Forspoken | FIRST EVER DirectStorage Gaming Test on a PCIe Gen5 SSD | Phison E26 | MAX GRAPHICS: https://www.youtube.com/watch?v=Zw3RbnXXnyI"Forspoken is the first game to support DirectStorage 1.1 on PC. The version can be confirmed by checking the file version of dstorage.dll. DirectStorage has been covered and tested on this channel on numerous occasions through tech demos, but today will be the first time testing it in an actual game. The game is installed on the fastest SSD currently available - the Phison E26 Gen5 engineering sample. This SSD was sent to me by Phison, and I benchmarked it in a previous video. While very fast, it uses 1600 MT/s 232L NAND from Micron. This NAND supports up to 2400 MT/s, so faster Gen5 SSD are on the way this year, which will be even faster. The game is running in 4K with ultra settings."

állítólag lesz majd "Gen5 vs Gen4 vs Gen3." teszt is. ( a következő napokban )

Mottó: "A verseny jó!"

-

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

PuMbA

titán

válasz

S_x96x_S

#40074

üzenetére

S_x96x_S

#40074

üzenetére

Ezek csak a marketing számok. A valóság mindig más. Téged le kéne tiltani, hogy ilyen marhaságokat nézz

![;]](//cdn.rios.hu/dl/s/v1.gif) Hogy mondták, hogy a PS5 Gen 4 SSD így meg úgy, aztán leragasztva az érintkezőket úgy, hogy 1700MB/s-ra csökken az olvasása a külső SSD-nek is tökéletesen megy minden játék. Tudod, mutatni kell a számokat és sok ember már megy is a boltba, lobogtatni a pénzt úgy, hogy elméleti dolgokat lát, amit még át se ültettek gyakorlatba....

Hogy mondták, hogy a PS5 Gen 4 SSD így meg úgy, aztán leragasztva az érintkezőket úgy, hogy 1700MB/s-ra csökken az olvasása a külső SSD-nek is tökéletesen megy minden játék. Tudod, mutatni kell a számokat és sok ember már megy is a boltba, lobogtatni a pénzt úgy, hogy elméleti dolgokat lát, amit még át se ültettek gyakorlatba....[ Szerkesztve ]

-

S_x96x_S

őstag

> Ezek csak a marketing számok. A valóság mindig más.

A valóság nem statikus

És az elmúlt 5 év játékainak a hw-igénye nem egyezik meg a következő 5 év játékainak a hw igényeivel.Mert ha megegyezne, akkor az nVidia nagy bajban lenne

és le kellene fizetnie egyes játékfejlesztőket,

hogy csináljanak magasabb hw-követelményt igénylő játékokat.

Egyébként is mi értelme lesz az nVidia 5090-nek, ha nincs játék ami ki tudná használni ?> Tudod, mutatni kell a számokat és sok ember már megy is a boltba,

trendekről beszélek és nem kötelező vásárlásról.

Lelkesedhetsz a Forma1 iránt egy Forma1-es autó nélkül is ...

Mottó: "A verseny jó!"

-

PuMbA

titán

válasz

S_x96x_S

#40078

üzenetére

S_x96x_S

#40078

üzenetére

"Egyébként is mi értelme lesz az nVidia 5090-nek, ha nincs játék ami ki tudná használni ?"

Számottevő értelme nem lesz. Most se nagyon van, ami kihasználja a 4090-et

Nézd meg például a Forspoken-t Ultra grafikán PC-n. Rosszabbul néz ki, mint az én RTX3060-amon a Red Dead Redemption 2, ami kiválóan fut magas grafikán 1440p-ben nálam. Hiába van giga-szuper hardvered, ha a szoftver rossz. A hamarosan jövő RTX fejlesztés a Cyberpunk 2077-ben fog mutatni valamit, illetve majd a Stalker 2. Egy csúcskártya a kiadás pillanatában nem sokat tud felmutatni, mert a játékokat a középkategóriára csinálják. Ezért adnak ki Portal RTX-et meg ilyen techdemókat, hogy örüljenek az emberek, mert amúgy a kártya majd 2 év múlva lesz rendesen kihasználva.

Nézd meg például a Forspoken-t Ultra grafikán PC-n. Rosszabbul néz ki, mint az én RTX3060-amon a Red Dead Redemption 2, ami kiválóan fut magas grafikán 1440p-ben nálam. Hiába van giga-szuper hardvered, ha a szoftver rossz. A hamarosan jövő RTX fejlesztés a Cyberpunk 2077-ben fog mutatni valamit, illetve majd a Stalker 2. Egy csúcskártya a kiadás pillanatában nem sokat tud felmutatni, mert a játékokat a középkategóriára csinálják. Ezért adnak ki Portal RTX-et meg ilyen techdemókat, hogy örüljenek az emberek, mert amúgy a kártya majd 2 év múlva lesz rendesen kihasználva.[ Szerkesztve ]

-

Busterftw

veterán

-

PuMbA

titán

válasz

S_x96x_S

#40078

üzenetére

S_x96x_S

#40078

üzenetére

"Lelkesedhetsz a Forma1 iránt egy Forma1-es autó nélkül is ..."

Ez így van, de egy 3-5 éves távlatban ugyanazok az ismétlődő folyamatok mennek vége a PC világban. Elvileg lesz valami csoda jó technológia, aminél kiderül, hogy a használatban azért nem annyira sima dolog, mert mindennek van előnye és hátránya és ezért elmarad a csoda. Ezért előre én nem lelkesedek, csak ha már a két szememmel látom játékban a dolgot, mert sokszor lelkesedtem már úgy, hogy semmi se lett belőle. Például amikor vettem AMD APU-t az A8-7600 személyében és semmi nem lett belőle és még sorolhatnám...ettől még lelkesedni lehet, de legtöbbször úgy se jön be, így minek spanoljam magam

[ Szerkesztve ]

-

S_x96x_S

őstag

> Ez így van, de egy 3-5 éves távlatban ugyanazok

> az ismétlődő folyamatok mennek vége a PC világban.... Gen2, Gen3, Gen4, Gen5, Gen6, Gen7 ...

A még gyorsabb adatkapcsolatra mindig szükség lesz ..Vajon lesznek-e olyan játékok, amelyek kihasználják majd a Gen5 GPU + M.2 -t ?

---> Biztos lesznek!

A Fejlesztőknek ( Gaming Engine tervezőknek ) figyelembe kell-e venni ezt a trendet?

---> Valamennyire igen!A GPU hardvert és a következő generáció konzolokat tervezőknek is észben kell ezt tartani ..

Mottó: "A verseny jó!"

-

PuMbA

titán

válasz

S_x96x_S

#40082

üzenetére

S_x96x_S

#40082

üzenetére

"A még gyorsabb adatkapcsolatra mindig szükség lesz"

A nagy kérdés, hogy meddig időzünk egy állomásnál és az a baj, hogy ezt nem lehet tudni. Példaként felhozom, hogy hiába csinált az AMD 16 magos asztali procit lassan 3 éve a Ryzen 9 3950X személyében, azóta is csak 8 magnál időzünk a gamer procik esetén, mert nem tudunk úgy játékot írni, hogy 16 magot rendesen kihasználjon

Simán lehet, hogy még évekig elég lesz a PCI-E Gen 3, aztán még jó pár évig a Gen4 és ami most téged nagyon lelkesítő Gen 5-ből csak 7 év múlva lesz valami. A kérdés, hogy érdemes-e lelkesedni 5-7 évre előre. Én inkább lelkesedek olyanért, ami már kézzel fogható, minthogy az elérhetetlen jövőbe révedjek.

Simán lehet, hogy még évekig elég lesz a PCI-E Gen 3, aztán még jó pár évig a Gen4 és ami most téged nagyon lelkesítő Gen 5-ből csak 7 év múlva lesz valami. A kérdés, hogy érdemes-e lelkesedni 5-7 évre előre. Én inkább lelkesedek olyanért, ami már kézzel fogható, minthogy az elérhetetlen jövőbe révedjek.[ Szerkesztve ]

-

Egyébként a CPU is nagy limit.

A grafika meg sajnos addig lesz előremutató ,amíg az Nvidia nem hagyja el a PC gaming szegmenst mert utána már a konzolok tudásához lesz mérve minden, ami szerintem most is már kevés. Igazából érdekes lenne majd megnézni az Ampere kártyákat 2 év múlva az akkori CPu kkal, mennyit is gyorsulnak, mennyi tartalék van még bennük.

A Ps5 gyenge, de kielégítő az árárhoz képest, de nagy előremutatást a PC re nem fog tenni.

Most sokan meg fognak kövezni ,de addig ez így lesz amíg szinte egy kaptafára készülnek a nagy konzolok.

Remélem történik részleges váltás és lesz AMD támogatású konzol és lesz Intel és/ vagy Nvidia is a másik nagyban vagy kis remény hogy az Új Switch odateszi magát, ha igazak a grafikus egységről szóló pletykák az új tegrával kapcsolatban.

JÓ lenne ha lenne akár egy típuson belül 3 különböző teljesítményű konzol. Xboxnál is működik szerintem az Xs olcsóbban és jó lenne egy közép majd ultra akár extra magas áron...Busterftw: [link] A mester írta le ezt.

![;]](//cdn.rios.hu/dl/s/v1.gif) RIP HBCC , jóslatok jönnek mennek

RIP HBCC , jóslatok jönnek mennek  , j

, j[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

-

T.Peter

őstag

válasz

S_x96x_S

#40082

üzenetére

S_x96x_S

#40082

üzenetére

Itt inkabb az a kerdes hogy te mit varsz attol hogy gyorsabb az ssd. Miben fog tobbet nyujtani szerinted egy jatekban?

PuMbA: Ne varjuk hogy a 8 magos konzolok mellett majd kulon pc-re atdolgozzak 16 magra.

b.: Szerintem egyik fejlesztonek sem lenne elonyos ha megint eltero hardverek lennenek. Foleg multiplatform cimeket gyarto studioknal. Nem hiszem, hogy ezt barki akarna.

-

válasz

T.Peter

#40087

üzenetére

T.Peter

#40087

üzenetére

Persze ez világos, fejlesztői és kiadói szemszögből ez az ideális. De a grafikai felődés így hosszú távon szinte zéró a PC hardverek tudásához nézve.

pont feljebb írtad ezt PuMbAnak leegyszerűsítve végső soron. Nekünk attól hogy multiplatfom egy cím ugyan úgy ki kell perkálni 70-90 eurot egy konzolos címért még ha félkész és bugos akkor is.( szinte az összes cím az mostanában) Switchre ami különálló platform sokkal minőségibb címek jönnek jobban optimalizálva és kevesebb buggal ugyan ezért az árért.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az nem a gyártókon és fejlesztőkön múlik, hanem az API-kon és az OS-en. Ez fogja vissza a PC-t. Egyik GPU-ra sem szállítanak PC-n a fejlesztők binárist, és sosem fognak, ahogy egyik PC-n sem érik el az OS-t megkerülve a memóriát, és sosem fogják. Ezek nélkül pedig sosem lehet kiszedni a hardverből az összes teljesítményt.

De gondolt el ezt fordítva. Ha bináris szállítanának x GPU-ra, és az OS-t megkerülve elérnék teszem azt a 16 GB-os dual channel memóriát, akkor csak azzal az x GPU-val, és csak 16 GB-nyi dual channel RAM-mal működne a program. Ha más GPU-d lenne, akkor ennyi volt, még azonos gyártónál is. Több vagy kevesebb memória szintén bukó. Szóval jó okkal olyan a PC, amilyen. Amelyik "PC" nem ilyen, az a konzol.

Valójában mindkét koncepciónak megvannak az előnyei és hátrányai, csak ezek mások.

De a Switch az egy fix hardver, ahogy a PS5 és az Xbox Series X/S is. Ezekre azért könnyebb kidolgozni egy relatíve problémamentes programot, mint PC-re, ahol van kismillió konfiguráció, kismillió OS verzióval. Persze szar dolog, hogy a PC-s port bugosabb, de ez mindig így volt, és mindig így lesz, mert a megugrandó léc a fix hardver és a fix szoftververzió hiánya miatt nem olyan alacsony. És persze lehet mondani, hogy ezért is kérik a sok pénzt a fejlesztők, ami igaz, de költségben a PC-s verzió a legdrágább, mert sok a hardver- és szoftvervariáció. Ha csak két-három fix specifikációra kellene tesztelni több száz vagy ezer helyett, akkor a PC-n is hasonló mennyiségű bug lenne, mint konzolon.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

T.Peter

őstag

Igy is epp eleg bugos a legtobb jatek, nem megegyezo hardveres alapokkal meginkabb az lenne.

Nintendo-n sem jobb a helyzet csak nem az exkluzivokat kell nezni. Ahogy a tobbinel sem. Bar az exkluzivokkal is nehezebb dolguk lenne mert ott is ujra kene tanulni jo par dolgot.

PuMbA-nak nem ezt irtam. Attol, hogy mas gyartotol jon a hardver meg nem lesz nagyobb a fejlodes. Nem akkorak a pc-s hardverek kozott sem az elteresek hogy szamottevo kulonbseg legyen. Biztos lenne valamennyi, de nem igazan eri meg. Fejlesztoi oldalon meg plane. A kovetkezo gen-be kene 32 de inkabb 64 giga ram meg joval erosebb processzor ami minimum 16 magos es akkor talan el lehetne kezdeni sokkal dinamikusabb vilagokat epiteni mert jelenleg szinte minden statikus, nulla rombolhatosag, fizika, stb. -

S_x96x_S

őstag

gyorsabb adatkapcsolatra mindig szükség lesz,

és a Gen5 alacsonyabb latency-je ( CXL követelmények miatt ) is ideális.

és egyszer talán lesz Coherent-Multi-GPU is,

amikor 2 kisebb GPU-t egyben tudja kezelni a rendszer a CXL/InfinityFabric-en keresztül.általánosságban:

- minden játékfejlesztő akkor kezdi alkalmazni az úgy ficsöröket, amikor úgy gondolja.

- minden felhasználó akkor upgradel, amikor úgy gondolja

- a GPU gyártók pedig az előző 2 csoportot különböző módon próbálják "ösztönözni" a váltásban.megj:

- a közgazdászok biztos valami tudományosabb magyarázatot adnának

- az UE 5 még eléggé új. de mutatja a trendet.

- az AVX512 -nek is vannak előnyei, ha a fejlesztőknek ilyen gépe lesz, akkor ennek a támogatása jobban meg fog jelenni a játékokban is. ( pl. UE5 - Embree )> mert nem tudunk úgy játékot írni, hogy 16 magot rendesen kihasználjon

A kedvenc játékom eléggé jól skálázodik 256, 512, 1024 .. core -ra

Vagyis ez a játéktól és algoritmusoktól is függ,

de főleg a gaming engineket lehet emiatt hibáztatni, de én látok jó irányú elmozdulást.Mottó: "A verseny jó!"

-

Ok, elfogaható érvek.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

PuMbA

titán

"Ezek nélkül pedig sosem lehet kiszedni a hardverből az összes teljesítményt."

De a PC-s hardverek vannak annyival gyorsabbak, hogy ezt erőből megoldják

A PS5 és az Xbox Series X grafikai szintjét már az első évben legyőzte egy felső kategóriás PC. 3 év múlva mészárolni fogja grafikai minőségben egy közép kategóriás PC a konzolt.

A PS5 és az Xbox Series X grafikai szintjét már az első évben legyőzte egy felső kategóriás PC. 3 év múlva mészárolni fogja grafikai minőségben egy közép kategóriás PC a konzolt.[ Szerkesztve ]

-

Wilks

tag

válasz

S_x96x_S

#40078

üzenetére

S_x96x_S

#40078

üzenetére

--Egyébként is mi értelme lesz az nVidia 5090-nek, ha nincs játék ami ki tudná használni ?

Szerintem azt te is tudod,h a kártyákat nem csak "játékra" fejlesztik.Főleg Nvidia.

Igy "létjogosultsága" lesz az 5000-es szériának.

Másfelől akkor is megveszik-megveszuk azokat a dolgokat,amiket nem tudunk 100%-an kihasználni.

Az emberi elme ilyen.......

Csakazértis,mutogassuk,h van a tulajdonukban ilyen is,stb....... -

DudeHUN

senior tag

Jelenleg a teljesítmény a kisebb probléma. Ha megnézed a HZD új része is cross-gen cím és mégis elképesztő látvánnyal bír. Ahogy a God of War új része is. Az meg a PS4-re készült még teljesen.

Az assetek elkészítése és a világok benépesítése ezekkel elképesztően sok meló. Ezért is húzódnak az igazi nextgen játékok. PC-n is. Plusz ára is van ennek a nagy teljesítménynek. Egyikünk sem tapsikol a 400-500+ wattos kártyáknak szerintem.

Az meg a legjobb forgatókönyv, ha egy középkat PC mészárolni fogja a konzolokat. Reméljük nem többszörös áron és akkor az azt jelenti, hogy genváltásnál megint lesz majd pár év múlva egy nagyon erős ugrás.[ Szerkesztve ]

Gamer for Life

-

PuMbA

titán

válasz

DudeHUN

#40095

üzenetére

DudeHUN

#40095

üzenetére

"Az assetek elkészítése és a világok benépesítése ezekkel elképesztően sok meló."

A grafika nagy részt attól függ, hogy mennyi munkát tettek bele a fejlesztők. Amit írtál, God of War: Ragnarok, ami majd ha PC-re megjelenik jól fog futni és kiválóan fog kinézni, mint ahogy a Red Dead Redemption 2 is kiválóan néz ki a mai napig, pedig 5 éves és semmiféle csúcs hardver nem kell hozzá. Az, hogy PCI-E 5.0 SSD jelenik meg vagy RTX5090, attól nem lesz jobb a grafika, vagyis nagyobb részben nem ettől lesz jobb a grafika. Legnagyobb részt a bele rakott munka miatt lesz jó a grafika.

A grafika nagy részt attól függ, hogy mennyi munkát tettek bele a fejlesztők. Amit írtál, God of War: Ragnarok, ami majd ha PC-re megjelenik jól fog futni és kiválóan fog kinézni, mint ahogy a Red Dead Redemption 2 is kiválóan néz ki a mai napig, pedig 5 éves és semmiféle csúcs hardver nem kell hozzá. Az, hogy PCI-E 5.0 SSD jelenik meg vagy RTX5090, attól nem lesz jobb a grafika, vagyis nagyobb részben nem ettől lesz jobb a grafika. Legnagyobb részt a bele rakott munka miatt lesz jó a grafika." Plusz ára is van ennek a nagy teljesítménynek. Egyikünk sem tapsikol a 400-500+ wattos kártyáknak szerintem."

Ez a gyártók sara. A kártyákat kiválóan lehet undervoltolni és underclockolni és máris 150W-ot faragtál, minimális teljesítmény eséssel.

[ Szerkesztve ]

-

Petykemano

veterán

válasz

S_x96x_S

#40070

üzenetére

S_x96x_S

#40070

üzenetére

Elnézést, elhamarkodottan ítéltem.

Az új mérések szerint valójában nincs negatív hatással a directStorage az fps-re [link]

A mérés volt hibás: a betöltési idő alatt az fps megugrik, mert nincs érdemi munkája a GPU-nak. A hosszabb betöltési idő pedig nagyobb mértékben húzza fel a átlagos fps értéket.Találgatunk, aztán majd úgyis kiderül..

-

gV

őstag

DLSS3-at kapott megint sok játék NVIDIA DLSS 3 Launching In Another 6 Games, Marvel’s Midnight Suns & HITMAN 3 | GeForce News | NVIDIA

van miért szidni az nV-t, de ezt azért elég jól csinálja, nem bejelentik, hogy majd mi lesz meg mit tudhat (FSR3) hanem itt van.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Állásajánlatok

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

Cég: Ozeki Kft.

Város: Debrecen

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Egy Gen3 SSD bőven elég lesz bármire évekig, mert annyira sok adatot képes az is mozgatni, ami egy jelenethez sosem lesz kevés, még 4K textúrákkal se. A Gen5 marad az ésszerűségen kívül.

Egy Gen3 SSD bőven elég lesz bármire évekig, mert annyira sok adatot képes az is mozgatni, ami egy jelenethez sosem lesz kevés, még 4K textúrákkal se. A Gen5 marad az ésszerűségen kívül.

A grafika nagy részt attól függ, hogy mennyi munkát tettek bele a fejlesztők. Amit írtál, God of War: Ragnarok, ami majd ha PC-re megjelenik jól fog futni és kiválóan fog kinézni, mint ahogy a Red Dead Redemption 2 is kiválóan néz ki a mai napig, pedig 5 éves és semmiféle csúcs hardver nem kell hozzá. Az, hogy PCI-E 5.0 SSD jelenik meg vagy RTX5090, attól nem lesz jobb a grafika, vagyis nagyobb részben nem ettől lesz jobb a grafika. Legnagyobb részt a bele rakott munka miatt lesz jó a grafika.

A grafika nagy részt attól függ, hogy mennyi munkát tettek bele a fejlesztők. Amit írtál, God of War: Ragnarok, ami majd ha PC-re megjelenik jól fog futni és kiválóan fog kinézni, mint ahogy a Red Dead Redemption 2 is kiválóan néz ki a mai napig, pedig 5 éves és semmiféle csúcs hardver nem kell hozzá. Az, hogy PCI-E 5.0 SSD jelenik meg vagy RTX5090, attól nem lesz jobb a grafika, vagyis nagyobb részben nem ettől lesz jobb a grafika. Legnagyobb részt a bele rakott munka miatt lesz jó a grafika.